- 모바일 및 엣지 장치에 최적화된 오픈 소스 모델, 성능과 안전성 모두 잡다

메타가 모바일과 엣지 장치에 최적화된 초경량 오픈 소스 소형언어모델(sLM)을 선보였다. 이 모델은 클라우드 서버에 의존하지 않고 엣지 디바이스에서 작동하도록 설계되었으며, 안전 조정 기능을 갖춰 높은 안전성을 보장한다.

마크테크포스트는 메타 연구진이 엣지 장치에서 로컬로 실행 가능한 소형 언어모델을 개발했다고 전했다. "이 모델은 안전하고 윤리적인 출력을 보장하는 안전 조정 모델로, '라마 가드 3-1B-INT4'라는 이름으로 9월에 처음 발표되었고, 이번에 세부 사항이 공개되었다"라고 소개했다.

라마 가드 3-1B-INT4는 이전 모델인 라마 가드 3-1B에 비해 크기가 7배 작아졌지만, 성능은 그대로 유지한다. 이를 위해 메타 연구진은 가지치기, 뉴런 수준 가지치기, 양자화 훈련 등 다양한 압축 기술을 활용했다. 가지치기는 중요도가 낮은 매개변수를 제거하는 방법이고, 양자화는 가중치를 낮은 비트 수로 표현하여 모델의 크기를 줄이는 기술이다.

압축 과정에서 발생할 수 있는 품질 저하를 방지하기 위해 증류 기술을 적용했다. 증류는 큰 모델의 지식을 작은 모델에 전수하는 방식으로, 라마 가드 3-8B 모델의 데이터를 활용하여 품질을 유지했다.

이 모델은 모바일 CPU에서 뛰어난 성능을 발휘한다. 초당 30토큰 이상의 처리량을 달성했으며, 첫 번째 토큰 출력 시간도 2.5초 이내로 빠르다. AI 모델의 성능을 평가하는 F1 점수에서도 0.904를 기록하여, 기존 모델인 라마 가드 3-1B의 0.899를 넘어섰다. F1 점수는 정밀도와 재현율의 조화 평균으로, 모델의 성능을 종합적으로 평가하는 지표다.

또한, 다국어 처리 능력도 우수하다. 프랑스어, 스페인어, 독일어를 포함한 8개 비영어 언어 중 5개 언어에서 기존 모델과 유사한 성능을 보였고, 제로샷 테스트에서는 GPT-4보다 7개 언어에서 더 나은 안전 조정 점수를 기록했다.

크기가 작고 최적화된 이 모델은 모바일 배포에 적합하다. 실제로 모토롤라 레이저 스마트폰에서 성공적으로 실행되어 모바일 환경에서도 원활한 성능을 증명했다. 이 모델은 깃허브에서 무료로 다운로드할 수 있어, 개발자들과 연구원들에게 유용한 도구가 될 것으로 기대된다.

메타는 이번 모델 공개를 통해 엣지 컴퓨팅과 소형 언어모델의 발전에 기여하고, 안전하고 효율적인 AI 기술 개발을 선도할 것으로 전망된다.

엔비디아, 주주들에게 중대 발표 예정 - 2월 26일 주가 요동에 주목

엔비디아(NVIDIA)는 2025년 2월 26일, 주주들을 위한 중대한 발표를 할 예정이다. 이 발표는 주식 시장에 큰 파급력을 미칠 수 있으며, 2월 11일 오후 주가가 3.16% 상승한 후, 13일에 이 소식을 전하는 영상이 공개되며 투자자들의 이목을 끌고 있다.엔비디아는 그래픽 처리 장치(GPU)와 인공 지능(AI) 기술 분야의 선두 기업으로, 이번 업데이트가 업계...

엔비디아, 주주들에게 중대 발표 예정 - 2월 26일 주가 요동에 주목

엔비디아(NVIDIA)는 2025년 2월 26일, 주주들을 위한 중대한 발표를 할 예정이다. 이 발표는 주식 시장에 큰 파급력을 미칠 수 있으며, 2월 11일 오후 주가가 3.16% 상승한 후, 13일에 이 소식을 전하는 영상이 공개되며 투자자들의 이목을 끌고 있다.엔비디아는 그래픽 처리 장치(GPU)와 인공 지능(AI) 기술 분야의 선두 기업으로, 이번 업데이트가 업계...

미국 정부, AI 도입으로 기회와 도전을 맞이하다

미국 정부, AI 도입으로 기회와 도전을 맞이하다

프롬프트만으로 1분만에 웹앱을 자동으로 생성하는 놀라운 서비스

프롬프트만으로 1분만에 웹앱을 자동으로 생성하는 놀라운 서비스

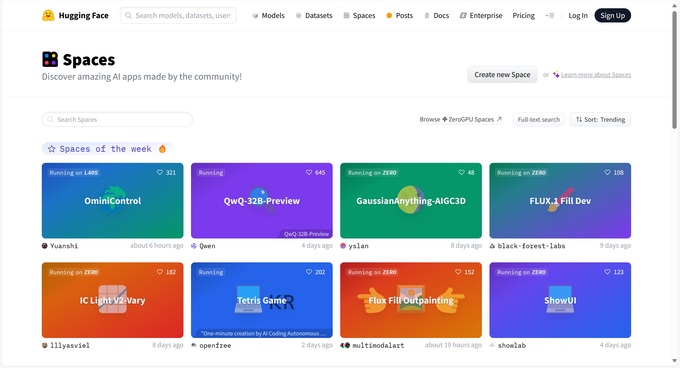

허깅페이스 전체 인기 순위 2위, 16만 다운로드 위업 달성 한국 스타트업

허깅페이스 전체 인기 순위 2위, 16만 다운로드 위업 달성 한국 스타트업

목록

목록