- 자체 개발 LLM, 사내 효율성 증대 및 대외 서비스로 확장

문화콘텐츠 플랫폼 예스24가 대형언어모델(LLM)을 활용해 업무 환경을 혁신하고 있다. LLM을 통해 개발자 업무 효율성을 높이고, 대외 서비스까지 확장하는 방안을 추진 중이다.

올해 하반기부터 예스24는 LLM을 개발자 업무에 적용해왔다. 10년 이상 축적된 사내 위키와 문서 데이터를 LLM과 RAG(검색증강생성) 기술을 활용해 체계적으로 관리하고, 사용자의 정보 요청에 신속하게 대응하고 있다.

사용자가 자연어로 질의하면 LLM이 위키 내 정보를 바탕으로 요약된 답변을 제공하고, 관련 정보 링크를 제시해 상세 내용을 쉽게 확인할 수 있다.

이러한 LLM을 통해, 검색으로 찾기 힘든 과거 업무 데이터를 손쉽게 획득할 수 있게 되었다. 예스24는 향후 자체 LLM과 RAG 기술을 더욱 발전시켜 사내 서비스를 확장할 계획이며, 언론사 등 다양한 업종에 적용하는 방안도 검토 중이다. 기술적 완성도를 높인 후에는 고객의 독서 경험을 향상하기 위한 서비스로까지 범위를 넓힐 예정이다.

예스24 권민석 플랫폼본부 이사는 "AI는 이제 업무 환경에서 필수적인 요소"라며, "개발, 영업, 마케팅 등 다양한 분야에 출판업에 특화된 LLM을 적용해 업무 효율성을 극대화할 것"이라고 강조했다.

예스24의 LLM을 활용한 업무 혁신과 대외 서비스 확장은 업계의 주목을 받고 있으며, 출판업계에서의 AI 활용 사례로 자리매김할 것으로 기대된다.

엔비디아, 주주들에게 중대 발표 예정 - 2월 26일 주가 요동에 주목

엔비디아(NVIDIA)는 2025년 2월 26일, 주주들을 위한 중대한 발표를 할 예정이다. 이 발표는 주식 시장에 큰 파급력을 미칠 수 있으며, 2월 11일 오후 주가가 3.16% 상승한 후, 13일에 이 소식을 전하는 영상이 공개되며 투자자들의 이목을 끌고 있다.엔비디아는 그래픽 처리 장치(GPU)와 인공 지능(AI) 기술 분야의 선두 기업으로, 이번 업데이트가 업계...

엔비디아, 주주들에게 중대 발표 예정 - 2월 26일 주가 요동에 주목

엔비디아(NVIDIA)는 2025년 2월 26일, 주주들을 위한 중대한 발표를 할 예정이다. 이 발표는 주식 시장에 큰 파급력을 미칠 수 있으며, 2월 11일 오후 주가가 3.16% 상승한 후, 13일에 이 소식을 전하는 영상이 공개되며 투자자들의 이목을 끌고 있다.엔비디아는 그래픽 처리 장치(GPU)와 인공 지능(AI) 기술 분야의 선두 기업으로, 이번 업데이트가 업계...

미국 정부, AI 도입으로 기회와 도전을 맞이하다

미국 정부, AI 도입으로 기회와 도전을 맞이하다

프롬프트만으로 1분만에 웹앱을 자동으로 생성하는 놀라운 서비스

프롬프트만으로 1분만에 웹앱을 자동으로 생성하는 놀라운 서비스

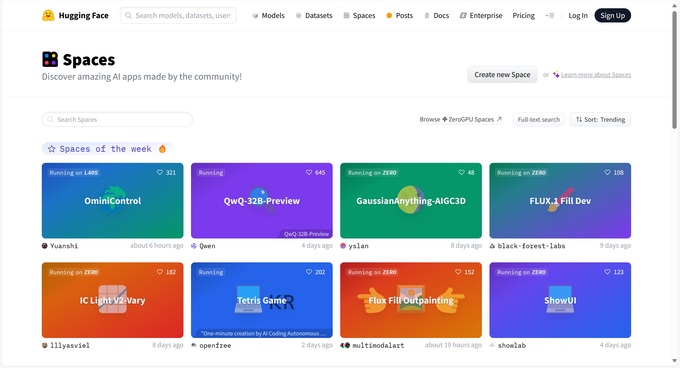

허깅페이스 전체 인기 순위 2위, 16만 다운로드 위업 달성 한국 스타트업

허깅페이스 전체 인기 순위 2위, 16만 다운로드 위업 달성 한국 스타트업

목록

목록