- 대규모 비디오 생성을 위한 혁신적인 프레임워크

텐센트가 오픈 소스 비디오 파운데이션 모델인 HunyuanVideo를 선보였다. 이 모델은 폐쇄 소스 모델과 동등하거나 그 이상의 성능을 보이며, 동영상 생성의 새로운 장을 열 것으로 기대된다.

HunyuanVideo는 데이터 큐레이션, 이미지-비디오 공동 모델 훈련, 대규모 모델 훈련과 추론을 위한 효율적인 인프라를 통합한 포괄적인 프레임워크를 특징으로 한다. 또한, 모델 구조를 확장하는 전략을 통해 130억 개 이상의 매개변수를 가진 비디오 생성 모델을 훈련시켰으며, 이는 모든 오픈 소스 모델 중 최대 규모이다.

탁월한 성능과 다양한 기능

HunyuanVideo는 높은 시각적 품질, 움직임 다양성, 텍스트-비디오 정렬, 생성 안정성을 보장하기 위한 광범위한 실험을 거쳤다. 전문가들의 평가에 따르면, 이 모델은 이전 최첨단 모델보다 우수한 성능을 보였으며, 특히 움직임 품질에서 두각을 나타냈다.

또한, HunyuanVideo는 텍스트 인코더로 사전 훈련된 멀티모달 대형 언어 모델을 사용하는데, 이는 이미지-텍스트 정렬을 향상하고 복잡한 추론 능력을 보여주었다. 이 모델은 제로샷 러닝도 가능하여, 다양한 텍스트 기반 비디오 생성에 유용하다.

오픈 소스 생태계 활성화

HunyuanVideo의 코드와 가중치는 공개되어, 폐쇄 소스와 오픈 소스 비디오 파운데이션 모델 간의 격차를 줄일 것으로 기대된다. 이를 통해 연구자와 개발자들은 동영상 생태계를 더욱 역동적이고 활발하게 발전시킬 수 있을 것이다.

주요 특징과 평가

HunyuanVideo는 Causal 3D VAE를 통해 공간-시간적으로 압축된 잠재 공간에서 훈련된다. 텍스트 프롬프트는 대형 언어 모델을 사용하여 인코딩되며, 가우시안 노이즈와 함께 모델에 입력되어 출력 잠재를 생성한다. 이 출력 잠재는 3D VAE 디코더를 통해 이미지나 동영상으로 변환된다.

또한, 이 모델은 트랜스포머 디자인을 도입하고, 통합된 이미지 및 비디오 생성을 위해 전체 어텐션 메커니즘을 사용한다. 비디오 생성을 위해 "듀얼 스트림에서 싱글 스트림으로"의 하이브리드 모델 디자인을 채택하여, 각 모달리티가 간섭 없이 독립적으로 학습할 수 있도록 한다.

평가 결과, HunyuanVideo는 폐쇄 소스 모델 중 5개의 강력한 기준선을 능가하는 성능을 보였으며, 특히 움직임 품질에서 우수한 성과를 거두었다. 이 모델은 동영상 생성의 새로운 기준을 제시하며, 연구와 산업 분야에서 광범위하게 활용될 것으로 기대된다.

엔비디아, 주주들에게 중대 발표 예정 - 2월 26일 주가 요동에 주목

엔비디아(NVIDIA)는 2025년 2월 26일, 주주들을 위한 중대한 발표를 할 예정이다. 이 발표는 주식 시장에 큰 파급력을 미칠 수 있으며, 2월 11일 오후 주가가 3.16% 상승한 후, 13일에 이 소식을 전하는 영상이 공개되며 투자자들의 이목을 끌고 있다.엔비디아는 그래픽 처리 장치(GPU)와 인공 지능(AI) 기술 분야의 선두 기업으로, 이번 업데이트가 업계...

엔비디아, 주주들에게 중대 발표 예정 - 2월 26일 주가 요동에 주목

엔비디아(NVIDIA)는 2025년 2월 26일, 주주들을 위한 중대한 발표를 할 예정이다. 이 발표는 주식 시장에 큰 파급력을 미칠 수 있으며, 2월 11일 오후 주가가 3.16% 상승한 후, 13일에 이 소식을 전하는 영상이 공개되며 투자자들의 이목을 끌고 있다.엔비디아는 그래픽 처리 장치(GPU)와 인공 지능(AI) 기술 분야의 선두 기업으로, 이번 업데이트가 업계...

미국 정부, AI 도입으로 기회와 도전을 맞이하다

미국 정부, AI 도입으로 기회와 도전을 맞이하다

프롬프트만으로 1분만에 웹앱을 자동으로 생성하는 놀라운 서비스

프롬프트만으로 1분만에 웹앱을 자동으로 생성하는 놀라운 서비스

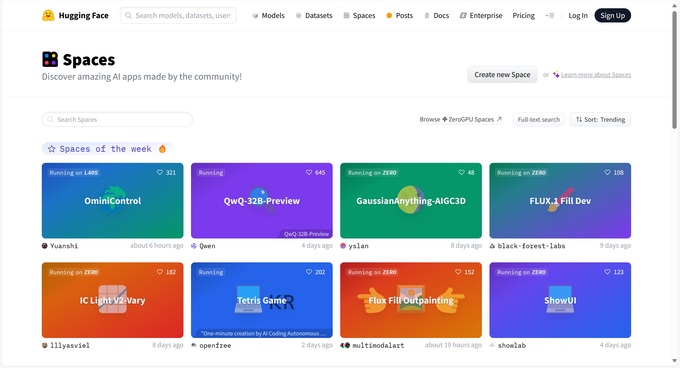

허깅페이스 전체 인기 순위 2위, 16만 다운로드 위업 달성 한국 스타트업

허깅페이스 전체 인기 순위 2위, 16만 다운로드 위업 달성 한국 스타트업

목록

목록